日期:2026年3月3日 作者:Kila

【超級懶人包】

-

Nvidia 幾乎獨佔了整個 AI 產業鏈的利潤:數據中心季度收入 $623 億,毛利率 75%,市值超過 $3 萬億。但它最大的客戶們正在集體反抗。Anthropic 簽下 Google 史上最大 TPU 訂單(高達 100 萬顆),Meta 在向 Nvidia 下單一週後就向 AMD 和 Google 各簽數十億美元訂單,OpenAI 首次用非 GPU 晶片(Cerebras)跑主力模型推論,甚至 Nvidia 自己也花了 $200 億收購推論晶片公司 Groq。這些動作指向一個結論:AI 產業正從「訓練軍備競賽」轉入「推論成本戰爭」,

而在推論這個佔未來 75% 到 80% 算力的戰場上,通用 GPU 不再是唯一選項,甚至不一定是最佳選項。 -

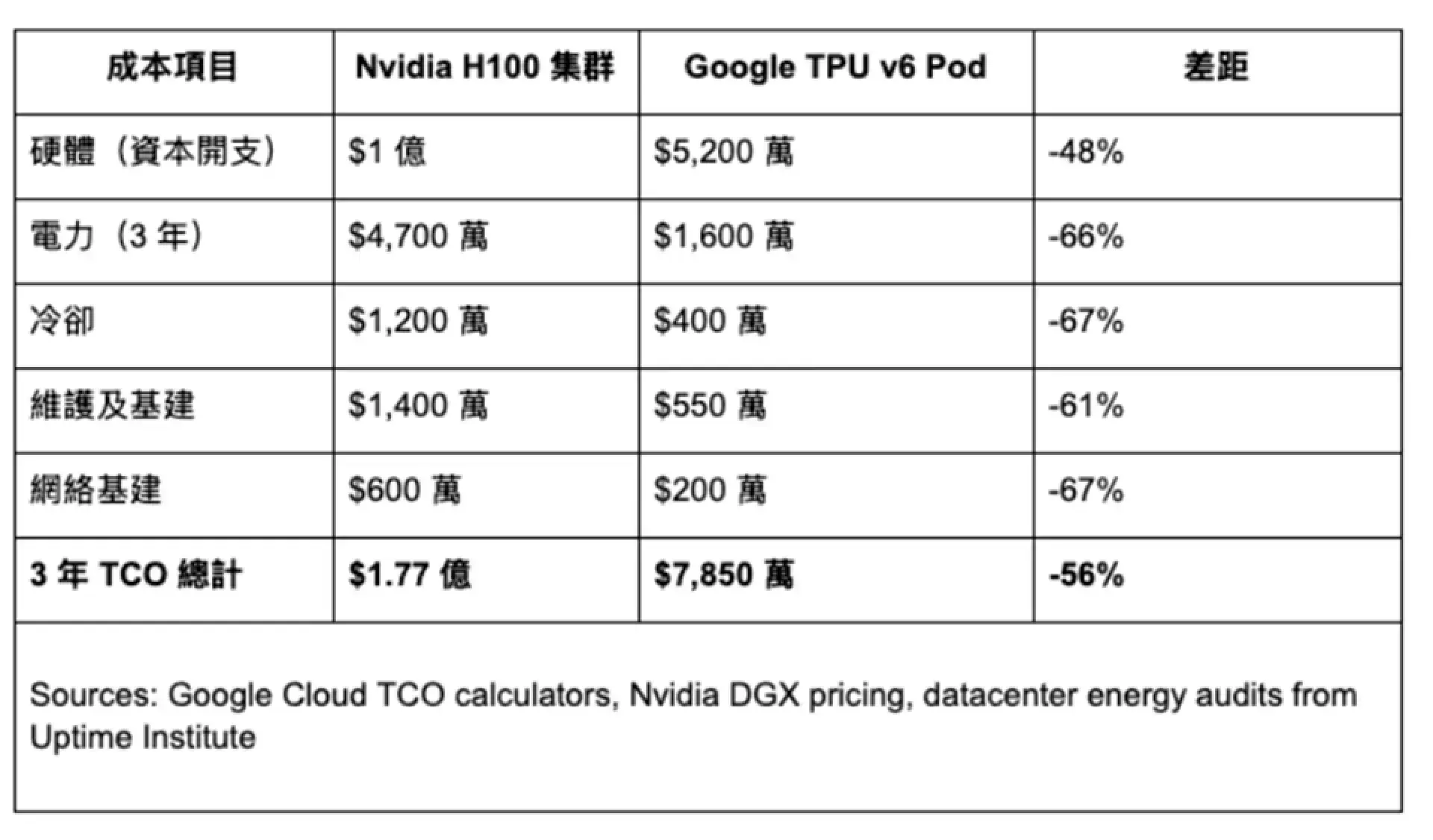

預訓練是一次性資本開支,推論是永續營運開支,兩者成本比可達 1:77。Google TPU 在大規模推論下 TCO 比 H100 低 44% 到 56%。摩根大通預計 Google 2027 年將部署 600 到 700 萬顆 TPU。高盛預測 2027 年非 GPU 晶片在 AI 伺服器的出貨佔比將從 36% 升至 45%。

-

TSMC 3nm 產能上限約每月 14 到 14.5 萬片晶圓,四大陣營搶奪。即使 ASIC 性價比完勝,產能瓶頸也會限制其取代 GPU 的速度。

Nvidia 賺走了整個 AI 的利潤,它的客戶不高興了

Nvidia 是過去兩年 AI 革命中最大的贏家,而且可能是唯一穩賺不賠的贏家。2026 財年第四季度,數據中心營收達到 $623 億美元,毛利率高達 75%,市值超過 $3 萬億。從 OpenAI 到 Google、從 Meta 到 Anthropic,幾乎所有 AI 公司都在向 Nvidia 付出天文數字的硬體費用。簡單來說,整個 AI 產業鏈的大部分利潤,最終都流進了 Nvidia 的口袋。

但 Nvidia 最大的客戶們,終於開始反抗了。

2026 年初,三件事幾乎同時發生,每一件都指向同一個結論。第一,

第二,AI 巨頭們集體「去風險化」。Anthropic 簽下 Google 歷史上最大的 TPU 訂單,承諾使用高達 100 萬顆 TPU,金額達 $210 億美元。Meta 在向 Nvidia 下達巨額訂單僅一週後,就轉頭向 AMD 簽下 6 吉瓦的算力訂單,同時與 Google 就數十億美元的 TPU 租用展開談判。即使是 Nvidia 最親密的合作夥伴 OpenAI,也與 Cerebras 達成合作,首次在主力模型 GPT-5.3 Codex 上大規模採用非 GPU 晶片完成推論部署。據路透社報道,OpenAI 曾多次對 Nvidia 晶片的響應速度表達不滿。

第三,摩根大通流出的一份產能報告顯示:Google 計劃在 2027 年部署 600 至 700 萬顆 TPU,大部分將供應給 Anthropic、OpenAI、Meta 及 Apple 等外部客戶。

這三件事的訊號再清楚不過:「AI 推論一定要用 Nvidia GPU」這個過去兩年市場深信不疑的假設,正在被全球最精明的 AI 公司用真金白銀推翻。

蓋工廠 vs. 開工廠:一個決定萬億美元走向的區別

要理解為什麼推論晶片市場如此重要,先要理解一個最基本的區別:

最簡單的比喻是這樣的。預訓練就像從零蓋一座工廠。

推論則是工廠蓋好之後,每天 24 小時接訂單、出貨的日常營運。每當你向 ChatGPT 提問、讓 Claude 寫一段代碼、用 Gemini 翻譯一篇文章,背後都是推論在運作。

這個區別在財務上的含義是驚人的。一個頂尖 AI 模型的訓練成本大約是 $1 至 2 億美元(一次性資本開支)。但這個模型投入服務後,5 年累計的推論成本可以高達 $100 億美元以上(持續性營運開支)。訓練與推論的成本比,可以達到 1:50 甚至 1:77。

這就是為什麼 AI 研究機構 Epoch AI 預測,到 2030 年,推論將佔全球 AI 算力的 75% 至 80%。再加上 AI Agent(智能體)的崛起,推論需求的天花板正在被不斷推高。

所以,推論晶片市場不是一個「幾百億美元」的市場。

上班不需要每天搭的士

市場上有一種根深蒂固的觀點:Nvidia GPU 性能絕對無敵,所以 GPU 在 AI 領域的地位不可撼動。

性能確實很好。這一點沒有人否認。但問題是:AI 的不同任務,是否都需要用到最頂尖性能的晶片?

打一個簡單的比方。的士確實是最快、最方便的交通工具,

這裏就要解釋 GPU 和 ASIC(特殊應用積體電路,如 Google TPU)的本質區別。

GPU 是一個通才運動員,能打多種運動,樣樣都不差。它之所以稱為「

ASIC 則是一位奧運短跑選手。它只做一件事,但做到了極致。

蓋工廠(訓練)的時候,你不知道會遇到什麼工程難題。

有人可能會質疑:ASIC 真的能在推論中佔有一席之地嗎?它的低靈活性難道不是致命傷嗎?

對於這個問題,其實不需要看分析師的報告。只需要看 Google、Meta、Anthropic、OpenAI 的實際行動。這些公司擁有全球最多的 AI 工程師和最精密的成本模型,它們不是在寫研究報告,

而 ASIC 過去最大的劣勢,即「低靈活性」,恰恰在推論時代被大幅削弱了。

最後,還有一個常被忽略的供應問題。即使你願意付高價買最頂尖的 Nvidia GPU 來跑推論,Nvidia 也未必能生產足夠的晶片來滿足全球推論的龐大需求。

誰的折舊在燃燒?

還有一個被市場低估的問題:Nvidia 的產品更新節奏,正在對科技巨頭的資產負債表構成持續壓力。

Nvidia 幾乎每年更新一代架構。2023 年是 H100,2024 年推出 H200 和 B200,2025 年是 GB200,2026 年下半年即將發布下一代 Vera Rubin。每一代的性能跳升幅度都非常大,這本來是好事,

換句話說,你去年花 $30 億買的 GPU 集群,今年在新一代面前性價比可能已經打了五折。

這種動態催生了一個非常合理的應對策略:訓練和推論,

訓練是與時間賽跑的。誰先訓練出更強的模型,誰就有先發優勢。

但推論不同。推論是穩態工作負載,24 小時不停地跑,對「最新最強」的需求遠低於對「穩定、便宜、

未來的算力架構,很可能不是「GPU vs. ASIC」的二選一,而是「最頂尖 GPU 負責訓練,舊 GPU 加上 ASIC 負責推論」的分層部署。

這對 Nvidia 的含義是什麼?訓練市場,它仍然是絕對的王者。

真金白銀的 TCO 比較

說了這麼多邏輯,最終一切都要用數字說話。

以一個 1,000 顆晶片的集群、24 小時運行推論工作負載、80% 使用率為基準,3 年的總擁有成本(TCO)對比如下:

最大的差距來自兩個地方:硬體成本和電力。電力差距尤其驚人。

摩根士丹利最新的「AI 推論工廠」利潤率模型提供了另一個角度:採用 Nvidia GB200 的推論工廠利潤率為 77.6%,Google TPU v6e 為 74.9%,AWS Trainium 為 68.5%。所有主流方案都能盈利,但 TPU 在成本結構上的優勢已被大量真實部署驗證:Midjourney 遷移至 TPU 後推論成本暴降 65%、Character.AI 實現 3.8 倍成本改善、Perplexity AI 的整個推論棧都運行在 TPU 之上。

最能說明問題的一個案例:根據半導體研究機構 SemiAnalysis 的報道,OpenAI 甚至不需要真的遷移到 TPU。僅僅靠「我們正在認真考慮轉向 TPU」這個可信的威脅,OpenAI 就成功從 Nvidia 談到了整支 GPU 艦隊約 30% 的折扣。

當一個威脅本身就能榨出 30% 的折扣時,定價權的天平已經在移動了。

(下篇預告:《推論戰場的五大勢力:從 CUDA 護城河到 TSMC 產能戰》將詳細拆解 Nvidia、Google TPU、AMD、雲端巨頭自研晶片與新創公司的技術路線、

免責聲明

本文內容僅供資訊及教育用途,不構成任何投資建議。