日期:2026年3月23日 作者:Kila

【超級懶人包】

-

GPU 硬件折舊今天佔 AI 推理總成本的六至七成半,電力只佔一至兩成。但 GPU 成本每年下跌四成,電價在資料中心走廊卻在飆升。

這條交叉曲線何時翻轉,至今沒有任何機構預測過。 -

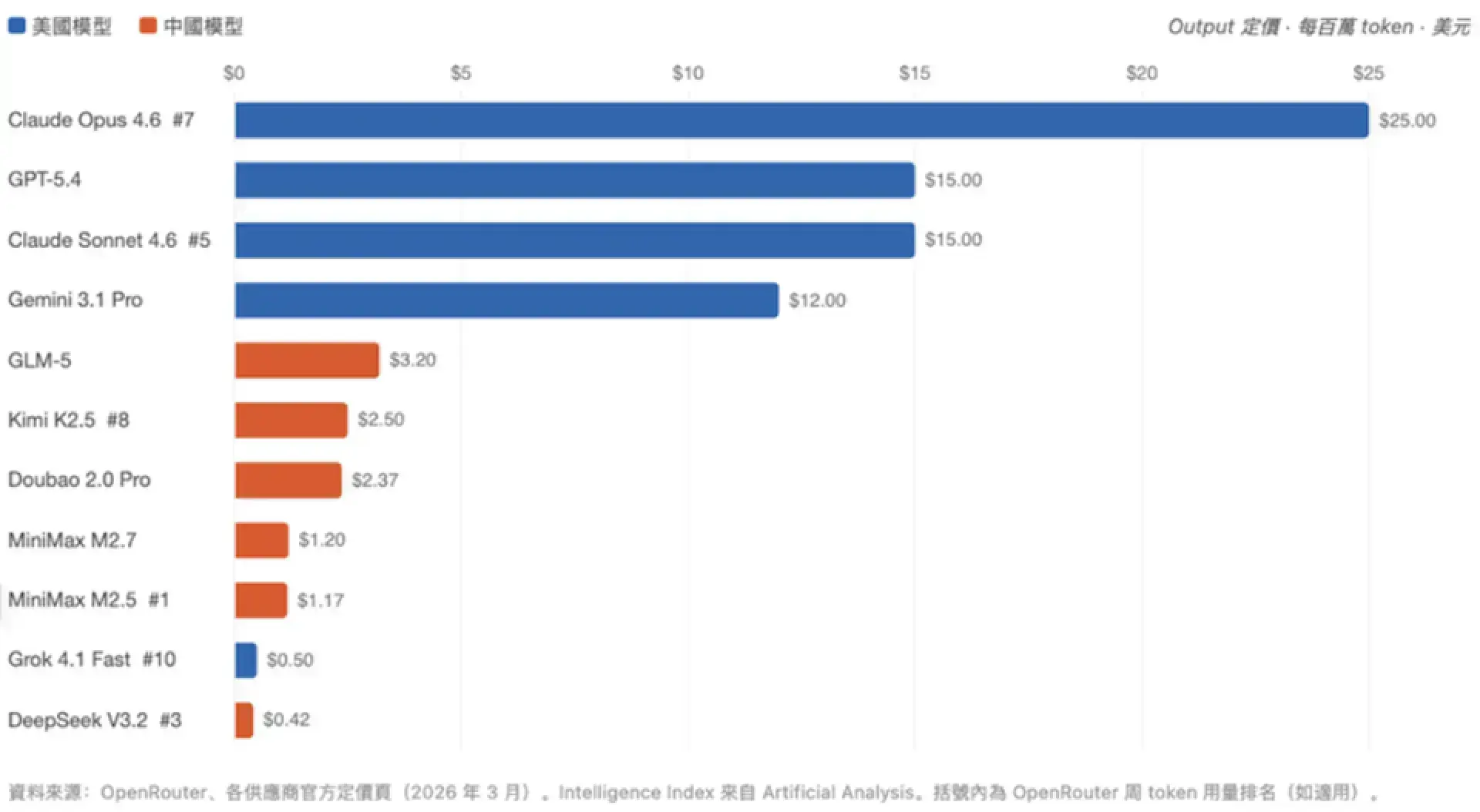

中國旗艦模型的 token 定價比美國同級低三至十倍。MiniMax M2.5 是 OpenRouter 全球用量排名第一的模型,output 定價是 Claude Opus 4.6 的二十一分之一。開發者用腳投票,投的不是最強大腦,

而是每一塊錢能煉出多少 token。 -

計入 PUE 後,中美最低成本地區的資料中心有效電價差距只有幾美仙。

真正的差距不在電價本身,而在基建速度: 中國建一條特高壓輸電線不到五年,美國一條跨州輸電線要十七年。 -

美國未來五年新增 245 GW 名義發電裝機,折算有效容量只有 28 GW。問題不是缺電,是缺「對的電」。併網排隊 2,600 GW,變壓器交期近三年。這是一場基建速度與 AI 需求之間的結構性賽跑。

Nvidia 創辦人黃仁勳在今年 GTC 大會上說了一句話:「資料中心是 AI 工廠,它把電力轉化為 token。」幾乎同一時間,OpenAI 的 Sam Altman 在 BlackRock 基建峰會上把 AI 描述為「一種公用事業,像電力和水一樣,人們會按錶計費」。

三個定義行業方向的人,同時把 token 和電力劃上等號。這不是巧合。

如果 token 真的要成為人類的基礎資源,那問題就變得非常簡單:

GPU 買得起,電供不起

拆解 AI 推理的成本結構,第一個反直覺的事實是:電力今天並不是大頭。

根據多個獨立來源的估算,在自營的超大規模 AI 資料中心中,GPU 硬件折舊佔推理總擁有成本(TCO)的 60% 至 75%,電力(包括冷卻)只佔 10% 至 20%。媒體經常引用的「電力佔資料中心成本四至六成」,

但這個比例正在逆轉。理解逆轉的邏輯,需要一個例子。

假設兩間公司使用同一款 GPU、同一個模型架構、同一套軟件堆疊。它們的 GPU 折舊成本完全一樣,人力成本大致相當,網絡和冷卻開支也差不多。

隨着推理晶片走向專用化(Nvidia 的 ASIC 收購、Google TPU、各家自研晶片),硬件成本正在加速趨同。Nvidia Blackwell 架構每瓦 token 產出是上一代 Hopper 的十倍,下一代 Rubin 還要再翻十倍。GPU 效率每年提升約四成,推理成本在三年內已經下跌了大約一千倍。

電力呢?方向相反。美國最大區域電網 PJM 的容量拍賣價格在一年內暴漲了八倍。維珍尼亞州,

GPU 成本在跌,電價在升。這兩條曲線終會交叉。交叉之後,

更麻煩的是傑文斯悖論(Jevons Paradox)。GPU 越高效,每個 token 越便宜,用量就越大。McKinsey 的分析直接警告:效率提升不會壓縮總電力需求,

中美 Token 定價的十倍落差

OpenRouter 的 API 用量排名是 AI 模型競爭最誠實的計分板。2026 年 3 月,全球用量前三名全是中國模型:MiniMax M2.5(周耗 1.68 萬億 token)、StepFun 的 Step 3.5 Flash(1.33 萬億)、DeepSeek V3.2(1.06 萬億)。開發者用腳投票,投的不是最高智能指數,

定價差距是數量級的。

Claude Opus 4.6 在 Artificial Analysis 的 Intelligence Index 得分 53,GPT-5.4 得 57.2。中國的 GLM-5 得 49.8,MiniMax M2.7 得 49.6。在 47 至 53 分這個區間,中美模型的能力差距已經相當有限,但 output 定價差距是四至二十一倍。

這個價差有七個疊加因素:MoE 架構效率(DeepSeek V3.2 有 6,710 億參數但每次只啟動 370 億)、虧損搶市定價、政府補貼、晶片制裁倒逼的軟件極限優化、電力成本、人力成本、開源策略。

電力在這七個因素中排第五。但它有一個其他因素都沒有的特性:隨規模放大,權重只會上升,不會下降。MoE 架構的效率增益有物理天花板。虧損定價不可能永續,智譜 AI 的港股 IPO 招股書顯示 2025 年上半年收入只有 $2,700 萬,虧損卻在加深。政府補貼受財政約束。晶片制裁下的軟件優化遲早會觸及硬件極限(DeepSeek 曾評估華為最先進的 Ascend 910C,認為仍不足以支撐下一代前沿模型的訓練)。

唯獨電力,只要推理規模繼續擴大,它在成本結構中的份量就會持續增加。這是物理定律,不是商業決策可以改變的。

美國的電力精煉廠,撞上了一面高牆

如果 token 的長期定價權最終取決於電力,那美國的處境就值得認真審視。

第一個出乎意料的發現:計入 PUE(電源使用效率)後,

但差距不在價格。差距在速度和規模。

美國電力系統的核心矛盾,用一組數字就能說清楚。基於 EIA、NERC 和美國能源部的規劃數據測算,2026 至 2030 年美國新增發電裝機容量為 337 GW,其中風光等間歇性電源佔了 257 GW(76%),天然氣只佔 80 GW。同期退役的幾乎全是高可靠基載電源,煤電 76 GW,氣電 13 GW。淨新增 245 GW 聽起來很多。但按有效容量系數折算(太陽能只有 10%,風電 40%,煤氣核水超過 80%),五年的有效淨新增容量只有約 28 GW。

245 GW 的帳面數字,28 GW 的實際容量。近九成的名義裝機增量,在電網最需要的峰值時刻,

這就是為什麼正如二月的渦輪機專題中所分析,

除了發電端,還有三個物理瓶頸同時卡住了美國的電力擴張。

EPRI 在 2026 年 2 月的最新報告將美國資料中心到 2030 年的用電佔比預測上調至 9% 至 17%,比 2024 年的估算高出六成。但反面聲音同樣值得重視:

預測在飆升,工地在停工。這個矛盾本身就是市場需要消化的信號。

煉鋁廠的教訓

如果覺得「電力成本重塑產業格局」聽起來太抽象,

鋁冶煉是最接近 AI 推理的工業類比。電力佔煉鋁生產成本的 30% 至 50%,一座大型冶煉廠的年耗電量可達 11 TWh,足以供應一座中型城市。1970 年代以前,美國憑藉豐沛且廉價的水力發電主導全球鋁業。隨後,

AI 資料中心今天的電力成本佔比(10% 至 20%)遠低於煉鋁(30% 至 50%)。但 IEA 預測,到 2030 年,美國資料中心的用電量將超過鋁、鋼鐵、水泥、

但 Sam Altman 自己說了:AI 的未來是公用事業。當 token 從「科技產品」變成「公用事業」,價格敏感度就會從零急速上升。

問題是,美國能在那一天到來之前解決它的基建瓶頸嗎?

免責聲明

本文僅供資訊及教育用途,不構成任何投資建議或招攬。