日期 2026 年 4 月 15 日 Kila

【超級懶人包】

-

博通賣的不是一顆 ASIC 晶片,而是把客戶設計變成可量產系統的整套工程能力。前 Google TPU 工程師 Henry 在訪問中把博通的角色形容為「髒活累活、非常吃經驗」。

這包括晶片間互聯(ICI)、SerDes、CoWoS 封裝協調、HBM 議價四件事。Google TPU 每顆估算售價 $13,000,相對其他 ASIC 客戶 $5,000,反映這層整合溢價。 -

純技術上博通並非不可取代。Marvell 和 Alchip 在 3nm 都有產品,Marvell 丟掉 AWS Trainium 3/4 是執行失手、不是技術代差。博通真正的護城河是「七代 TPU 累積的整合 know-how、網絡晶片 bundle、CoWoS 配額、HBM 議價位置」這個組合拳。

-

推論市場從訓練手中奪權是結構性事實。Deloitte 估 FY26 推論已佔 AI 運算 67%。Midjourney 遷到 TPU 後月度成本由 $210 萬降至 $70 萬,SemiAnalysis 估 ASIC 在 hyperscaler 規模下 TCO 比 Nvidia GPU 低 40-65%。這個趨勢對博通形成優勢。

-

Nvidia 的反攻力度比市場承認的強。$200 億吞下 Groq 等於拿走 TPU 編譯器 DNA,NVLink Fusion 把客製化 ASIC 強行變成 Nvidia 的收入,XLA 黑盒令第三方 Google Cloud 用戶只能跑到 50-60% 的 TPU 性能。推論市場將會分層,不是 ASIC 一統天下。

博通不是 Google,但沒有博通就沒有今日的 Google

Epoch AI 今年公佈一組令市場重新校準的數字。全球 AI 晶片總算力約 2,130 萬顆 H100 等效單元,Google 一家佔了 500 萬,全球第一。這 500 萬當中,Google 自家 TPU 佔 380 萬,Nvidia GPU 只佔 120 萬。

380 萬顆 TPU 背後,站着的是博通。

更少人留意的一層事實是,TPU 最大的外部客戶不是簽下 $210 億大單的 Anthropic,也不是剛剛宣佈 10 GW 合作的 OpenAI。據前 Google TPU 工程師 Henry 在《硅谷 101》訪問中披露,最大外部客戶是 Apple。Apple AI 團隊不少核心工程師由 Google 過檔,把整套 TPU 軟件堆疊順勢帶過去,Apple Intelligence 模型全部由 TPU 訓練。

這幾組數字放在一起,才看得出博通在 AI 基建圖譜裏的真實位置。但這個位置要用一個更基本的問題來切入:

博通提供的不是晶片,是量產能力

外界最容易誤會的一點,是以為博通在 ASIC 合作中扮演「晶片設計公司」的角色。事實並非如此。Henry 的描述很精準:TPU 的前端由 Google 自己畫圖紙,博通接手的是把圖紙變成可量產系統的後端工作,

這四件事缺一不可。TPU Pod 最大的賣點是幾千顆晶片可以當一顆用,這個「感覺像一顆」是由 3D Torus 拓撲 + 光學交換機(OCS)+ 銅線直連組成的工程藝術,其中 SerDes 要把訊號從一顆晶片精準無誤傳到另一顆。博通的 DSP-based SerDes 是業界最成熟的一套,從 112G 做到 224G,448G 已在 2026 年 DesignCon 展示原型。

HBM 是另一塊命門。Henry 直言,「未來幾年的方向可能就是 HBM 能決定你的上限。如果你買不到好的 HBM,訓練效率就會大打折扣。」HBM 由 SK hynix、三星、Micron 三家壟斷,Nvidia 長期是第一大客戶。TPU 一直是「次要客戶」的待遇,直到 V7 才靠着 Anthropic、Apple、Meta 的外部需求湊出足夠訂單鎖定產能。

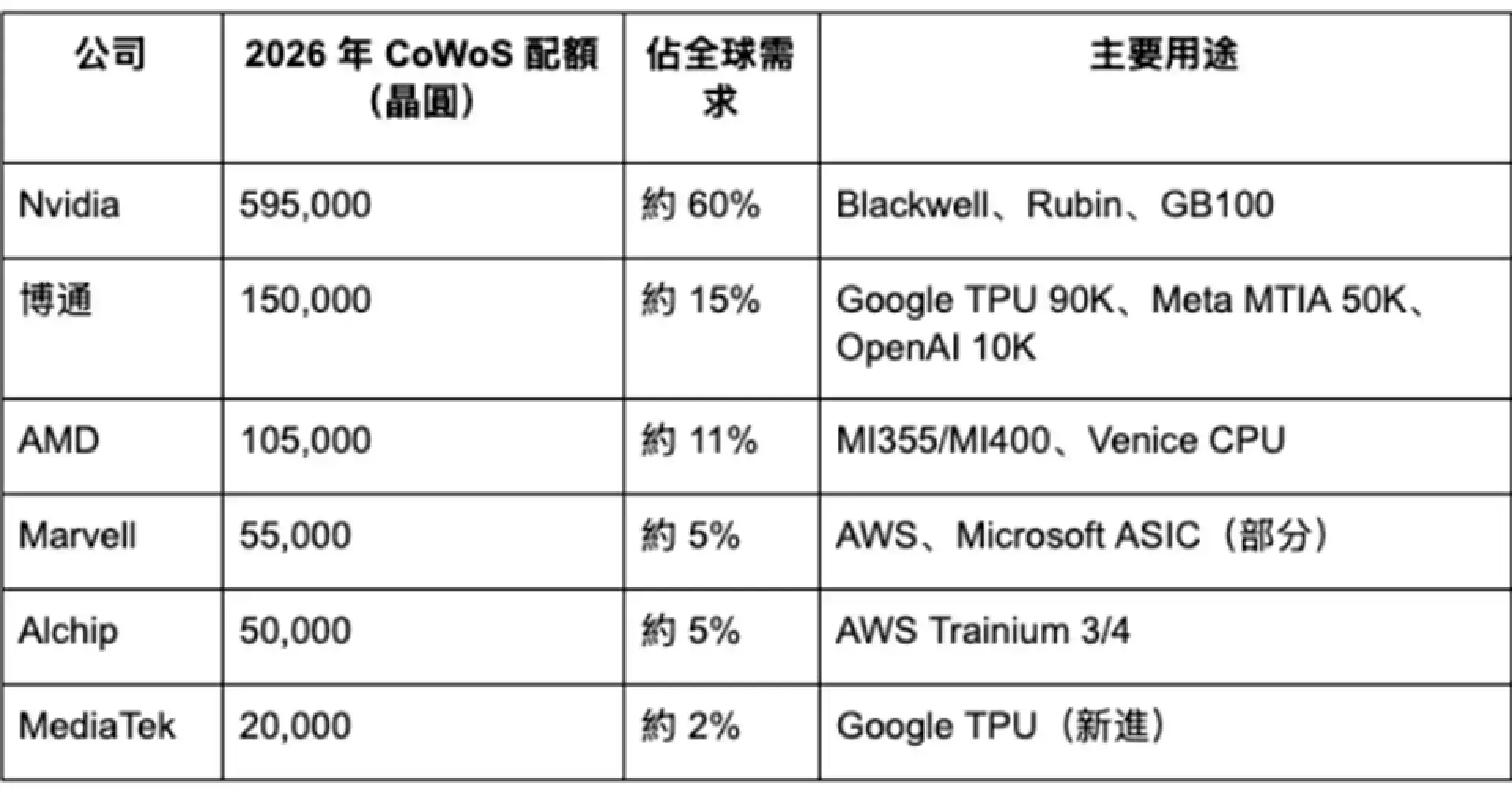

CoWoS 封裝也是同樣邏輯。TSMC 2026 年 CoWoS 總產能約 96 萬片晶圓,博通拿到 15 萬片,僅次於 Nvidia 的 60 萬片。以下是 Morgan Stanley 2026 年供應鏈分析的拆解:

HSBC 估算,博通在 Google TPU 的平均售價約為每顆 $13,000,其他 ASIC 客戶只有 $5,000。這個三倍溢價反映的不是晶片本身貴三倍,

技術上 Marvell 追得上,但 Marvell 丟了單

市場有一種說法指博通在 SerDes 或封裝上領先同業一代。這個說法嚴格而言不成立。Marvell 的 112G/224G SerDes 在 Microsoft Maia 100 已量產,Teralynx 10 交換機 ASIC 的紙面規格與 Tomahawk 5 差距有限。Alchip 更是連 2nm 測試晶片都已經 tape-out,在 AWS Trainium 3 的量產節奏上反而跑贏博通在 OpenAI 晶片上的時程。

那為什麼 Marvell 近一年在 ASIC 戰場上連失多城?答案寫在 AWS Trainium 2 那份 SemiAnalysis 報告裏。Marvell 在 Trainium 2 的 RDL interposer 設計上出了問題,直接導致 Amazon 把 Trainium 3、Trainium 4 的合約轉交給台灣的 Alchip,Marvell 只保留約 20% 的次要封裝份額。

這件事傳達的訊號與市場想法相反。

Henry 的原話講得比較清楚:「如果非常依賴 Broadcom、沒有備選的話,你在成本上就很難控制得下來。

真正的護城河是組合能力

把博通的位置拆解成四個獨立層面比較容易看清楚:

網絡晶片。Tomahawk 6 於 2025 年出貨,102.4 Tbps 交換容量,支援 64 個 1.6T 以太網埠,可組成支援百萬 GPU 叢集的網絡骨幹。博通在以太網交換 ASIC 的市佔估計達 80%,交貨期超過 40 週,形同 51.2 Tbps 以上級別的 sole-source 供應商。Tomahawk Ultra 主打 sub-250ns 低延遲 scale-up、Jericho 4 處理 fabric routing。Nvidia 的 GPU 運行時,有相當一部分數據仍要經博通的網絡矽片路過。

CXL-over-Ethernet。博通 2025 年的一項專利(US12360937B2)把 CXL 協議封裝在標準以太網幀內,讓 hyperscaler 可以在現有 Tomahawk 5/6 網絡之上動態池化記憶體和加速器,延遲仍保持在 100 納秒以下。這項技術直接把「網絡」和「記憶體池」

TSMC 產能位置。博通在 CoWoS 的 15 萬片配額是 Marvell 的近三倍,反映 TSMC 內部對客戶執行力的評分。這個位置不是錢能直接買到的。

七代 TPU 累積的整合經驗。這層最難描述,但可能是最關鍵。Henry 用「髒活累活」形容博通的後端工作,但也補了一句「

這四層疊在一起,博通的真實競爭對手其實只有「

推論時代放大這個位置

推論市場由訓練手中奪權,是過去兩年最確定的結構性變化。

Henry 解釋得很到位。GPU 的 SIMT 架構是「廚房裏有很多獨立思考的大廚」,TPU 的脈動陣列(systolic array)是「流水線,少調度、少調控、利用率高」。加上 XLA 編譯器做 Pod 級別全局算子融合,整顆 TPU Pod 在已知任務負載下可以把 HBM 頻寬和矩陣單元都跑到峰值。他的結論是:「在大規模部署、

實際案例強化這個判斷。Midjourney 由 A100/H100 遷到 TPU v6e 後,月度運算成本由 $210 萬降至 $70 萬,幅度 67%。Character.AI 錄得 3.8 倍成本改善。SemiAnalysis 估在 hyperscaler 規模下 ASIC TCO 優勢達 40-65%。

博通同時是這波趨勢的最大基建供應商。每一顆送進 Anthropic 3.5 GW 叢集的 TPU v7 Ironwood,都經過博通的封裝、ICI 互聯、網絡協議棧。

但 Nvidia 的反攻比市場承認的強

問題是,Nvidia 不會乖乖讓出推論市場。

2025 年 12 月 Nvidia 斥資 $200 億收購 Groq。Groq 的創辦人 Jonathan Ross 是原 Google TPU 編譯器團隊核心,XLA 那套靜態編譯思路是他帶出去創業的。Nvidia 拿到 Groq 等於吸收了「如何把編譯器當武器」的 know-how,也吸收了 Groq 3 LPU 在 Agent 級推論場景上的 35 倍能效優勢。

NVLink Fusion 是更強的一着。Nvidia 把 NVLink 變成開放 I/O 標準,但強制每個 NVLink Fusion 平台至少包含一顆 Nvidia 元件。結果是:即使 hyperscaler 選用博通 ASIC,Nvidia 仍然收到錢。配合 2026 年 4 月對 Marvell 的 $20 億投資,Nvidia 等於把 ASIC 競爭對手變成自己的次要通路。

TPU 自身也有對外擴張的天然障礙。Henry 在訪問中承認,第三方客戶透過 Google Cloud 使用 TPU 時,通常只能跑到 50-60% 的峰值利用率,要拿到近 100%,客戶必須直接購買 TPU 機架、並把整套軟件棧遷到 JAX/XLA。目前直接買機架的只有 Anthropic 一家。換句話說,TPU 的 TCO 優勢對大部分外部客戶是打折的。

這點把「推論時代 ASIC 一統天下」的說法拉回現實。更合理的情景是市場分層:超大規模、

收束:護城河深,但集中

回到開篇的問題:為什麼所有大客戶都找博通。答案不是博通技術比 Marvell 領先一代,而是博通在「把一套複雜的客製化系統穩定量產」

但護城河深,不等於業務面廣。博通 FY25 AI 收入 $200 億裏,Google 一家據分析師估算佔 ASIC 部分 78%。這種集中度在七代合作的穩定期裏是資產,

市場給博通的 forward P/E 26 倍、$1.8 萬億市值,究竟定價了什麼?這條問題留到下篇拆解。

免責聲明

本文僅供資訊及教育用途,不構成任何投資建議或招攬。